NVIDIA DGX Sparkで手元にオリジナル生成AI

近年、生成AIの発展により、大規模言語モデル(LLM)や画像生成モデルなどを活用したアプリケーションが急速に広がっています。これらのAIはクラウド上で利用されることが多い一方で、研究開発や独自モデルの活用では「手元でAIを動かしたい」というニーズも高まっています。

こうした背景の中、NVIDIAが発表したのがAI開発向けワークステーション NVIDIA DGX Spark です。DGX Sparkは、研究者や開発者がローカル環境でAIモデルの学習や推論を行えるように設計された新しいプラットフォームです。

本記事では、DGX Sparkの特徴や用途を整理しながら、どのような場面で活用できるのかを紹介します。

DGX Sparkの特徴

NVIDIA DGX Spark は、AI開発をローカル環境で実現するために設計されたワークステーションです。従来のGPUサーバーやクラウド環境とは異なる特徴を持つため、そのいくつかを紹介していきたいと思います。

ローカル環境で生成AIの学習、推論が可能

DGX Sparkの最大の特徴は、生成AIの学習、推論を手元の環境で行える点です。128GBものメモリに加え、FP4で最大1PFLOPSのパフォーマンスを発揮するため、オープンソースとして公開されている多くのSLMは1台で推論実行が可能です。また、今年のGTCにて「DGX Sparkは最大4台まで連結可能」と発表されました。4台連結により当然メモリ量も4倍になるため、パラメータ数の大きなモデルの学習やチューニングも可能となります。

AI開発のための統合環境を意識したワークステーション設計

DGX Sparkは単なる高性能PCではなく、手元でAIモデルを開発、実行するために必要な様々な機能が搭載されています。データやモデルを保存するための内部ストレージやネットワーク接続のためのNICに加え、様々な外部機器へ接続するためにUSB、Wi-Fi、Bluetoothなども備えられています。また、これだけの機能を搭載しているにも関わらず、消費電力は240W程度と非常に低く設計されており、まさしく机上で動作するAI統合開発環境となっているのです。

DGXシリーズの思想を継承したコンパクトなシステム

先の特徴で述べた通り、DGX Sparkは非常にコンパクトな設計になっていますが、これまでのDGXシリーズの思想もしっかりと受け継いでいます。複数台(複数GPU)を連結する接続においては、GPU間の通信ボトルネックが低減されるように200Gbpsで通信可能なConnectX-7のNICを搭載しています。また、OSについてもDGX OSが利用可能で、ユーザーはドライバ等の細かい設定を必要とせず、すぐにGPU機能を使うことができます。

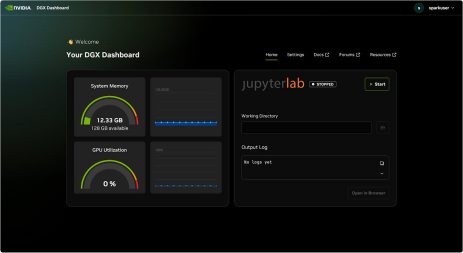

NVIDIA AIソフトウェアスタックとの統合

DGX SparkはNVIDIAが提供するAIソフトウェアスタックと密接に統合されています。DGX OSのみでなく、CUDAによるGPUアクセラレーション、各種AIフレームワークなどを使って、ユーザーは即座にAI開発を始めることができます。また、これらの様々なソフトウェアスタックはNVIDIAが提供するNGCからコンテナベースでダウンロードが可能であるため、構築も非常に容易です。

以上がDGX Sparkの主な特徴です。まとめると、DGX Sparkとは、「手元のGPUでAI開発」という、これまで高いと思われていたハードルを押し下げてくれるような製品ではないでしょうか。

DGX Sparkスペック

以下にDGX Sparkのスペックを紹介します。

| Architecture | Grace Blackwell |

| CPU |

20core Arm (10 Cortex-X925 + 10 Cortex-A725) |

| GPU | Blackwell |

| パフォーマンス | 1petaFLOPS FP4 |

| メモリ |

128GB (システムメモリ + GPUメモリ) |

| ストレージ | 4TB NVMe |

| USB | 4 × USB TypeC |

| Ethernet | 10GbE (RJ45) |

| NIC | 200Gbps ConnectX-7 |

| Wi-Fi | WiFi7 |

| Bluetooth | BT5.4 w/LE |

| Audio-output | HDMI multichannel audio output |

| 消費電力 | 240W |

| OS | DGX OS |

DGX Sparkの使い道

ここまではDGX Sparkの特徴について紹介してきました。次に、このDGX Sparkを使って、どのようなことができるのかを紹介したいと思います。先に述べた通り、DGX SparkはAI統合開発環境として様々な機能を搭載しているため、その用途も多岐に渡ります。

- 生成AIの研究開発

画像、動画など様々な生成AIの開発やマルチモーダルAIの検証など - LLMの開発、検証

独自データによる追加学習やファインチューニングなど - ローカル環境でのAI推論

エッジ環境でのAIアプリケーションの実行やリアルタイム推論処理など - AIアプリケーションの開発

AIモデルを組み込んだアプリケーションの開発やAIエージェントへの機能追加など

以上のように、様々なAIモデルで検証から推論実行まで、多くの用途に利用することできます。

では、具体的にどの程度のAIモデルを学習、推論することができるのでしょうか。

まずは、LLMの推論実行について考えてみます。LLMの推論では、基本的にモデルをGPUメモリに載せることができれば実行可能になります。当社環境にて検証したところ、FP16で30B程度のパラメータ数をもつモデルをGPUへロードした場合に必要なメモリ量が約100GBでした。これはあくまで参考数値であり、モデルの入出力トークン数などが変われば、当然必要なメモリ量も変わってしまいますが、30B程度のモデルであればDGX Sparkにて十分に推論実行が可能であると考えられます。量子化によってFP4などのより低精度を使用できれば、動かせるモデルサイズはさらに大きくなるでしょう。

※注意:DGX Sparkの128GBのメモリはCPUと共有されているため、すべてをGPU計算に使用することはできません。

次に、LLMの学習やチューニングについても考えてみます。学習の場合、推論とは異なり、バッチサイズやアクティベーションによってもGPUメモリを消費するため、実行できるモデルサイズは推論時の半分以下になると考えられます。しかし、先にも述べた通り、DGX Sparkは最大4台まで接続可能となったため、4台すべてを学習に使用すれば推論時と同じく数十Bクラスのモデルの学習も十分実行可能になると考えられます。現在、オープンソースLLMのトレンドは小規模、高精度となっており、多くのモデルが数B~数十B程度の大きさになっていますが、DGX Sparkはそのほとんどのモデルで学習、推論の実行が可能であるということです。

最後に

今回のブログでは、NVIDIA DGX Sparkの特徴と用途について紹介しました。これまでコスト面からあきらめていたが手元で生成AIを作ってみたいという方や、クラウドには出せない独自データでオリジナルLLMをカスタマイズしてみたいという方にとっては非常に興味深い製品だったのではないでしょうか。

ブログをお読みになり、NVIDIA DGX Sparkにご興味がある方はぜひ当社までお問い合わせ下さい。