GPUが用いられる理由とは?AI時代の必須技術とその選び方について徹底解説

AIをはじめとする先端技術が発展し、自社でそれらを導入しようと考えている企業も多いかと思います。しかし、AI開発には大きなコストがかかるため、自社で一から導入するのが難しい企業もあるのではないでしょうか。 AI開発には膨大な演算処理が求められるため、演算装置として「GPU」がよく利用されます。元々GPUは画像処理を行う装置でしたが、最近ではAI開発に利用されています。この記事では、GPUを使ったAI開発の現状とGPUの選び方、おすすめのGPU環境について解説します。 一からGPU環境を整備するのが難しい方向けに、低コストでGPUを使ったAI開発を検証できる環境についてもご紹介します。AI開発を検討中の方はぜひ参考にしてみてください。

- AI開発とGPU

- GPUの選び方

- GPUを使ったAIシステムを試してみる

- まとめ|AI開発にはNVIDIA製GPUで構想を

AI開発とGPU

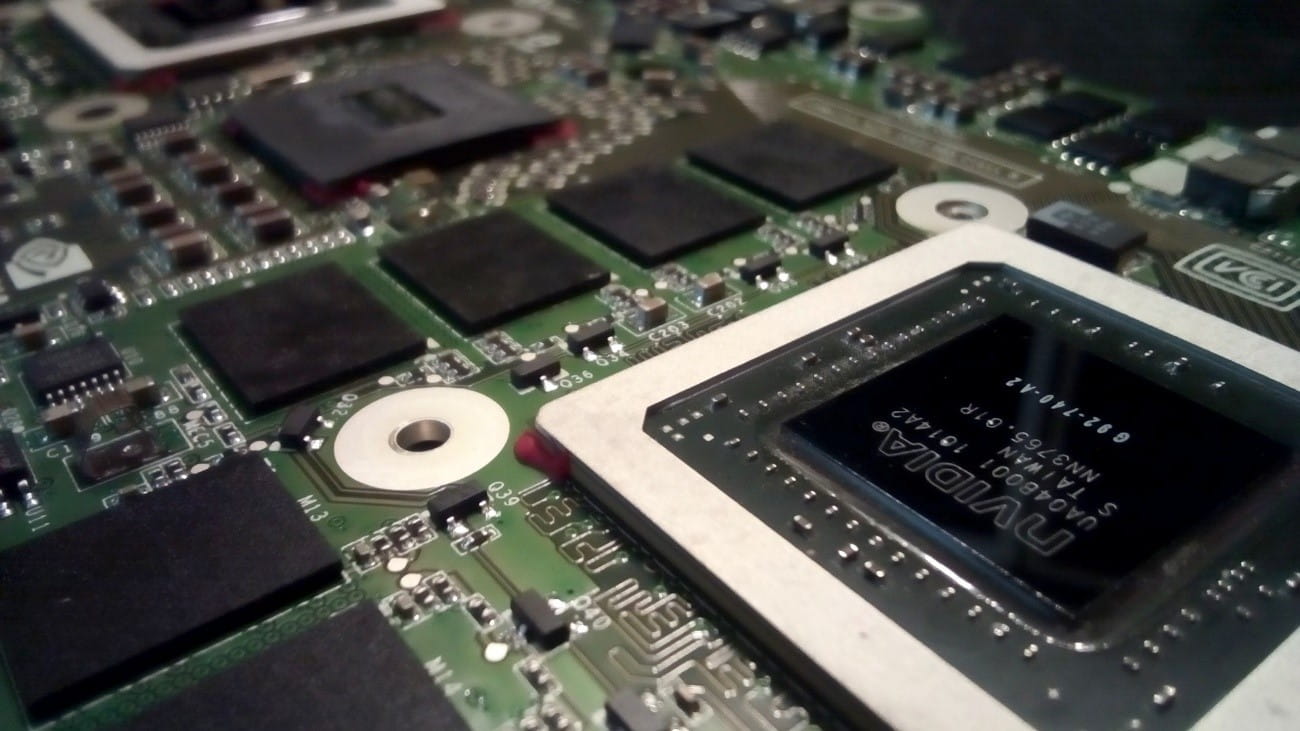

ピンチアウトで拡大

GPUは近年、AI開発現場で盛んに利用されています。それでは、なぜGPUはAI開発で用いられるのでしょうか。ここではその理由と、どのような分野でGPUが利用されているのか、解説します。

AI開発とGPU

GPUがAIに使われている理由は、その並列計算能力の高さにあります。GPUは本来、「Graphics Processing Unit」の名の通り、画像処理を行う装置を指します。GPUは元々、パソコンのグラフィックボードなどに使われていました。

AIは膨大な演算処理を必要とする技術です。例えばディープラーニングは、「ニューラルネットワーク」と呼ばれる人の神経細胞の仕組みに着想を得た計算モデルをベースにしている技術です。データの入力を行う入力層と、出力を行う出力層との間に、データの特徴量を抽出、保持する中間層を配置し、それらの層が結びつくことで複雑な判断ができます。これがディープラーニングの基本的なしくみです。

ディープラーニングにおいて、基本的には中間層の数が多くなるほど複雑な判断ができるようにはなります。そのためには大規模な計算が必要となりますが、従来、コンピュータの計算装置といえばCPUが主流でした。最近ではGPUが主に利用されています。GPUはCPUほど複雑で多様な処理はできませんが、並列処理を得意としており、同じような計算を高速で繰り返すことができます。GPUのこうした処理性能が、高速な並列処理を求められるディープラーニングに向いていたことから、AIの開発にGPUが用いられているのです。

GPUが用いられるAI分野

元々、GPUは画像処理に利用されていた演算装置ではありますが、AI分野に関しては、GPUは画像処理以外の分野でも利用されています。例えば、ディープラーニングは行列計算を主としています。行列計算には並列計算能力が高いGPUが向いているため、画像処理に限らず言語処理や音声処理にもGPUは使われています。

元々GPUは画像処理に特化した演算装置でしたが、その計算能力を幅広く活かせるように開発されたGPUを「GPGPU(General Purpose Computing on GPU)」と呼びます。GPGPUは画像処理以外にも、高い並列計算能力を要求する分野で利用されています。

GPUの選び方

ピンチアウトで拡大

それでは、実際にAI開発を行うには、どのようなGPUを選べば良いのでしょうか。ここでは、GPUを選ぶポイントとおすすめのGPUをご紹介します。

AIを実行する上でのGPUを選ぶポイント

ここではまず、AIを実行するうえでのGPUを選ぶポイントを解説します。GPUを選ぶ際は、次のポイントに注目してみましょう。

・コスト

・コア数

・メモリ容量とメモリ帯域

・発熱/冷却処理性能

・消費電力

コスト

1つ目のポイントはコストです。GPUを用いたAI開発において、高精度な処理を実現するには大きなコストがかかります。GPUそのものだけでなく、オンプレミスでGPUを利用した環境を構築するのにかかるコストも考慮しなければなりません。

最近では、コストをおさえられるクラウド環境上で利用できるGPUも普及しつつあります。コストと性能を共に評価したうえで導入するGPUを検討しましょう。

コア

コアとは、CPUやGPUなどの内部にある演算回路のことで、装置の中核を担う部品です。このコアが多いほど処理効率が高くなります。CPUは1つのプロセッサに数個のコアしか備えていませんが、GPUは数千個のコアを備えています。

コア数はGPUの処理性能に直結するため、選ぶ際には必ずチェックしましょう。GPUの性能を測る際によく使われる指標として「CUDAコア」と「Tensorコア」があります。いずれも、GPUメーカーのNVIDIAが提供しているGPUを利用したコアを指しており、「CUDAコア」は映像処理に、「Tensorコア」は行列計算に特化したコアで、AI開発に向いています。GPUをAIに利用する際には、「Tensorコア」を搭載したGPUを選択すると良いでしょう。

メモリ容量とメモリ帯域

GPUを選ぶ際は、メモリ容量とメモリ帯域にも注意しましょう。メモリが大きいほど、巨大なAIモデルを載せることができます。メモリ帯域が広いほど処理速度が速くなります。

ゲーミングPCなどのグラフィックボードに利用されるGPUであれば、メモリ容量は2GBから24GB程度が一般的です。しかし、AI開発にはより大容量のメモリが必要です。例えば、AI開発に向いているNVIDIA製GPU「NVIDIA A100 Tensor コア GPU」であれば、メモリは40GBや80GB確保されています。また、同製品ではメモリ帯域も「1,935GB/s」や「2,039GB/s」確保されており、高い処理速度が実現できます。

発熱/冷却処理性能

GPUの弱点の1つが、高性能であるがゆえの発熱です。高速で膨大な処理を行うため発熱し、冷却装置も必要になります。もちろんGPUの種類や行う処理にもよりますが、冷却装置についても気をつけると良いでしょう。

消費電力

GPUには、消費電力が大きくなりやすいというデメリットもあります。高度な、大規模な処理を行うほど消費電力も多くなるため、高消費電力に耐えられるだけのGPUインフラを構築しなければなりません。GPUそのものだけでなく、GPUを利用したAI開発のためのインフラの整備にも配慮しなければなりません。

おすすめのGPU「NVIDIA|NVIDIA A100 TENSOR コア GPU」

おすすめのGPUとして、「NVIDIA」社の「NVIDIA A100 TENSOR コア GPU」をご紹介します。「NVIDIA A100 TENSOR コア GPU」は、AI開発やデータ分析、HPC(ハイパフォーマンス・コンピューティング)などに要求される大規模かつ複雑な計算処理を可能にする高性能GPUです。

ディープラーニングに特化した装置である「Tensorコア」を搭載しており、高速なAI開発が実現できます。よりAI開発に向いたGPUで、同社による前世代のGPUと比較して、AI開発が前世代GPUより二倍以上高速になります。

また、「NVIDIA|NVIDIA A100 TENSOR コア GPU」は最大7つのインスタンスに分割可能です。1つのGPUを複数に分割して同時に扱うことができるため、リソースを最適化して複数のプロジェクトを同時に進められます。特に企業でのAI開発において力を発揮するGPUです。

GPUを使ったAIシステムを試してみる

ピンチアウトで拡大

GPUを使ったAIシステムの構築は、どのような手順で行えば良いのでしょうか。ここでは、一般的にAIシステムを構築する手順について解説し、GPUを使ったAIシステムを試す方法をご紹介します。

AIシステムの構築手順

AIシステムの構築は主に、次の4つの手順から行われます。

・構想フェーズ

・PoCフェーズ

・実装フェーズ

・運用フェーズ

「構想フェーズ」は、AIを使ってどのような課題を解決するのか、どの程度の費用対効果が予測されるのかを検討するフェーズです。AI開発そのものを目的とするのではなく、AIを使ってどのような課題解決やビジネスチャンスに結び付けるのかを明確にしなければなりません。AI開発には大きな費用がかかるため、GPUをはじめとするハードウェアの費用や、開発にかかる費用なども検討が必要です。

「PoC」フェーズは、実際にAIを使って課題解決が可能かを検証する段階です。「PoC」とは「Proof of Concept」の略称で、「概念実証」を意味します。考えていることが実現可能かどうかを検証する、といった意味があります。このフェーズでは、AIのプロトタイプを作成してデータを用意し、学習・検証を行わなければなりません。そのため、このフェーズで早くもGPUを導入した検証が必要になります。

「実装フェーズ」と「運用フェーズ」はそれぞれ、PoCフェーズでの検証を基に、実際にAIシステムを実装し、運用する段階です。

こうしたフェーズを経てAI開発は実施されますが、実際のところGPUを利用した大規模なAI開発にはかなりのコストがかかります。一般的には、AI開発にかかる費用相場は1000万円を超えており、中には1億円に達する場合もあります。PoCフェーズの段階で数百万円かかることも少なくはありません。

GPUを使ったAIシステムを試してみる

GPUを使った高性能なAIシステムの構築は大規模なプロジェクトで、大きなコストが掛かります。一からGPUを選定し、インフラを構築するのは難易度が高いため、自社だけでまかなうのはおすすめできません。

そこで、まずはGPUを使ったAIシステムを試してみるのがおすすめです。東京エレクトロンデバイスでは、AIアクセラレータとエンジニアサポートを同時に利用できる「TED AI Lab Engineering Service」(TAILES)を提供しています。

https://cn.teldevice.co.jp/technical_support/tailes/

「TAILES」では、NVIDIA社製のGPUを利用した、世界最速級のディープラーニング環境をすぐに利用可能です。それだけでなく、機器の使用方法やディープラーニングに関する専門的な知識を備えたエンジニアによるサポートを受けられます。

自社で一からAIシステムを構築することなく、すぐに性能検証やデモを実施することができます。最短2週間、100万円から利用できるため、コストをおさえたAI構想が可能です。もちろん、利用終了時には、今後のアクションについてエンジニアから提案を受けることもできます。

AI開発を検討中の方は、ぜひTED AI Labから利用を検討してみてください。

まとめ|AI開発にはNVIDIA製GPUで構想を

ピンチアウトで拡大

本記事では、GPUを使ったAI開発について解説してきました。GPUは元々画像処理に使われる演算装置でしたが、近年ではその処理性能を活かしてAI開発でも盛んに利用されています。

AI開発に利用するGPUを選ぶ際は、コストや消費電力などを見極める必要がありますが、特に大切なのはコアの数と性能です。ディープラーニングにGPUを利用する場合は、「NVIDIA」社製GPUの中でも、ディープラーニングに特化した「Tensorコア」を搭載したものを選択すると良いでしょう。最近では、Tensorコアを搭載した高性能な最新モデル「NVIDIA DGX H100」の発売も予告されています。

とはいえ、実際にGPUを使った大規模なAIシステムを構築するには、大きなコストがかかります。低コストで最新のGPUを用いたAI開発の検証を実施したい方は、弊社が提供している「TED AI Lab Engineering Service」(TAILES)から利用を検討することをおすすめします。

AI開発のためのGPUインフラを構築したい方は、同じく弊社が提供している「TED AI Infrastructure Package」(TAIP)の利用もあわせてご検討ください。NVIDIA社性GPU「A100」を備えたサーバーと、大容量かつ高速なデータ通信ができるスケールアウトNASにより、AI開発をサポートします。